Llama ha evolucionado más allá de ser un simple modelo de lenguaje, convirtiéndose en un marco de inteligencia artificial multimodal con características de seguridad, generación de código y soporte multilingüe.

Meta presentó la familia Llama en febrero de 2023 y desde entonces ha lanzado múltiples versiones.

Su enfoque de ofrecer modelos más pequeños pero entrenados con más datos desafió el dominio de gigantes como OpenAI y Google, que apuestan por modelos enormes y cerrados.

¿Es realmente de código abierto?

No del todo. Aunque Meta liberó los modelos Llama bajo una licencia abierta, impone restricciones comerciales (principalmente para grandes empresas como AWS, Google Cloud y Microsoft Azure) y de uso aceptable (por ejemplo, prohíbe su uso para desarrollar armas o drogas).

Por ello, no cumple completamente con la definición formal de software de código abierto, según la Open Source Initiative.

Problemas legales ⚖️

Meta enfrenta demandas colectivas por el supuesto uso no autorizado de libros con derechos de autor para entrenar Llama. Aunque la mayoría de las acusaciones fueron desestimadas, en septiembre de 2024 el tribunal reconoció que Meta sí entrenó sus modelos con obras protegidas.

El punto legal pendiente es si eso constituye un “uso justo” según la ley de copyright.

Evolución de los modelos Llama desde 2023

Llama Guard 1 ️

Modelo de 7 mil millones de parámetros (basado en Llama 2), diseñado para detectar contenidos dañinos en entradas y salidas de modelos. Categoriza daños como violencia, odio, contenido sexual, armas, suicidio y planificación criminal.

️ Lanzamiento: 13 diciembre 2023

Code Llama 70B

Versión para generación y comprensión de código que tiene tres variantes:

- General

- Optimizada para Python

- Instruct (enfocada en seguir instrucciones de forma segura)

Tamaños: 7B, 13B, 34B y 70B parámetros. Es excelente generando código y puede usarse comercialmente.

️ Lanzamiento: 29 enero 2024

Llama Guard 2 ️

Basado en Llama 3 con 8 mil millones de parámetros. Clasifica contenidos en 11 categorías de riesgo según el estándar MLCommons.

️ Lanzamiento: 18 abril 2024

Meta Llama 3

Modelos de 8B y 70B, en variantes preentrenadas y ajustadas para instrucciones. Ideales para diálogos.

️ Lanzamiento: 18 abril 2024

Prompt Guard

Clasifica prompts peligrosos o manipulados (como intentos de “jailbreak”). Basado en BERT, solo da etiquetas.

️ Lanzamiento: 23 julio 2024

Llama Guard 3 ️

Tres versiones: solo texto (1B, 8B) y una versión con visión (11B). Multilingües. Incluyen nuevas categorías como elecciones y abuso de intérprete de código.

️ Lanzamiento: 23 julio 2024

Meta Llama 3.1

Modelos multilingües generativos (texto-entrada, texto-salida) de 8B, 70B y 405B parámetros. Compatible con 8 idiomas principales.

️ Lanzamiento: 23 julio 2024

Meta Llama 3.2

Modelos más pequeños (1B y 3B), enfocados en tareas multilingües como diálogo, recuperación de información y resumen. También hay modelos cuantizados.

️ Lanzamiento: 24 octubre 2024

Llama 3.2-Vision ️

Modelos multimodales (entrada de texto e imagen, salida de texto). Usados para razonamiento visual, subtitulado e interpretación de imágenes.

️ Lanzamiento: 25 septiembre 2024

Soporte de idiomas para texto: inglés, alemán, francés, italiano, portugués, hindi, español y tailandés ️ Para tareas con imagen, solo se admite el inglés.

Meta Llama 3.3

Modelo multilingüe de 70B parámetros. Preentrenado y ajustado para instrucciones.

️ Lanzamiento: 6 diciembre 2024

El Llama Stack

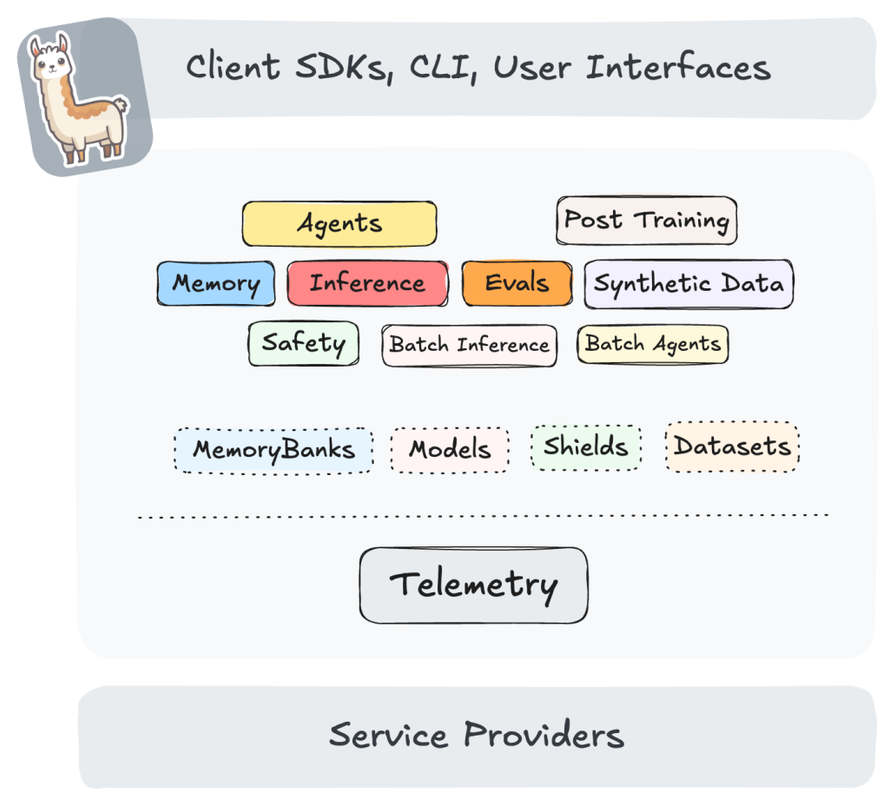

Llama Stack es el marco de implementación que unifica los distintos modelos de Meta. Permite conectar herramientas como:

- Brave Search: búsquedas web

- Wolfram Alpha: cálculos matemáticos

- Intérprete de código: generación y ejecución de Python

Compatible con SDKs para Python, Swift, Node y Kotlin, y puede usarse localmente (por ejemplo, con Ollama) o en la nube.

¿Dónde puedo usar Llama?

Puedes ejecutar modelos Llama en Linux, Windows, macOS y en la nube. Incluso es posible correr modelos cuantizados en laptops potentes como un MacBook Pro M4.

Conclusión

Llama ya no es solo un modelo de texto. Se ha convertido en un ecosistema de IA completo con capacidades multimodales, generación de código, detección de contenido sensible y soporte multilingüe.

Aun así, sigue en debate su licencia “semi-abierta” y enfrenta desafíos legales por sus datos de entrenamiento.