El equipo de Yandex presentó una versión beta de la red neuronal YandexART (Vi) para crear vídeos de cinco segundos.

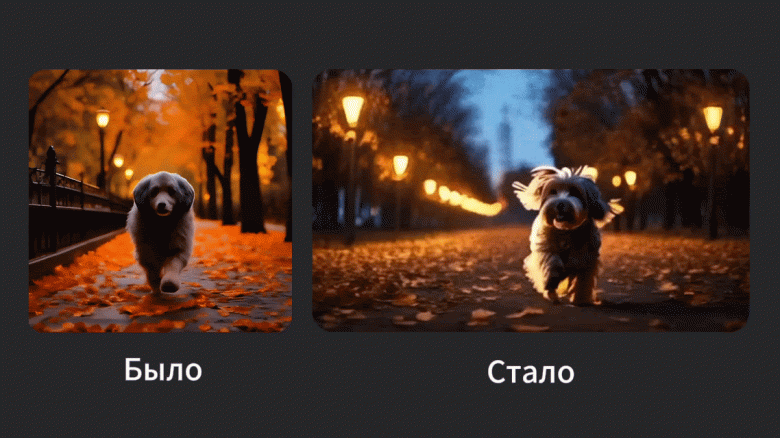

Como dijeron en el servicio de prensa, el modelo aprendió a recrear los movimientos suaves de los objetos en el marco, por ejemplo, un perro corriendo, una hoja que cae de un árbol o una explosión de fuegos artificiales.

[content-egg module=Amazon products=”es-B0CYNLSSZ6″ template=list]

La red neuronal puede ser utilizada tanto por usuarios comunes para crear, por ejemplo, un protector de pantalla animado único para su teléfono, como por blogueros, animadores y otros especialistas. YandexART (Vi) ya está disponible en la aplicación Masterpiece.

La compañía presentó una versión anterior del modelo para generar videos a partir de descripciones de texto en agosto del año pasado. La solución anterior nos permitió obtener animaciones que parecían como si la cámara se estuviera moviendo, pero no el objeto.

Mejores Herramientas de Inteligencia Artificial para la Creación de Vídeos

Además, los objetos cambiaron significativamente durante la generación de un cuadro a otro. YandexART (Vi) ha aprendido a recrear movimientos realistas, así como a tener en cuenta la relación entre fotogramas; gracias a esto, los vídeos se obtienen de forma más fluida y fluida.

[content-egg module=Amazon products=”es-B0DF5ZR69X” template=list]

Para que la red neuronal pudiera hacer frente a esta tarea, se entrenó con vídeos con objetos en movimiento, por ejemplo, un coche en movimiento o un gato furtivo.

La red neuronal crea una secuencia de fotogramas que se reemplazan imperceptiblemente entre sí y forman un vídeo fluido. Como entrada, el modelo recibe una descripción de texto del usuario sobre lo que debería estar en el marco (por ejemplo: “Un rinoceronte baila hip-hop en un bosque oscuro”) y crea una imagen con la que comenzará la animación.

[content-egg module=Amazon products=”es-B0CD5L9WDV” template=list]

Luego, el modelo convierte gradualmente el ruido digital en una secuencia de fotogramas basados en esta consulta de imagen y texto.