En septiembre de 2025, Nvidia y OpenAI anunciaron una carta de intención histórica: una posible inversión de hasta 100.000 millones de dólares para impulsar la infraestructura de inteligencia artificial de OpenAI.

Cinco meses después, el acuerdo NO se ha cerrado aún y los CEO de ambas empresas han decidido lanzar tremenda BOMBA de HUMO al respecto.

Como si de un truco de magia se tratase y luego de inflar hasta el infinito el mercado de la IA, sobresaturando los precios de todo lo que lleve cualquier tipo de chips informáticos en su interior..

Tanto el CEO de Nvidia, como el CEO de OpenAI, han decidido dedicarse mensajes bidireccionales por “twitter.. Con los que se auto felarse los penes el uno al otro; ante el miedo que surgió entre los inversores tras las aclaraciones del CEO de Nvidia en un pequeño foro.

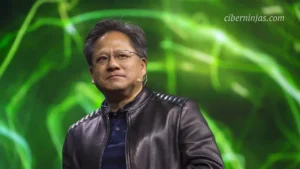

Según Huang, CEO de Nvidia actual, esa cifra “nunca fue un compromiso” y según infinidad de medios, OpenAI estaría explorando alternativas a los chips de Nvidia.

Vamos a analizar la situación con un poco más de profundidad.

¿Existió realmente un acuerdo de 100.000 millones?

La clave está en el término “carta de intención”. El anuncio inicial hablaba de un plan extremadamente ambicioso: lo equivalente a desplegar hasta 10 gigavatios de sistemas Nvidia para OpenAI.. Una cifra equivalente a la producción energética de aproximadamente 10 reactores nucleares.

Incluso, Jensen Huang llegó a afirmar que el proyecto equivaldría al total anual de envíos de GPU de Nvidia.

Sin embargo:

- Esto NO era un contrato vinculante.

- La cifra era más bien un “hasta 100.000 millones”.

- Estaba sujeta al cierre de una importante ronda de financiación por parte de OpenAI, que finalmente parece ser que jamás llegó.

Recientemente, Huang ha aclarado públicamente que esa “carta” “nunca fue un compromiso” y que Nvidia invertirá “paso a paso” con el paso del tiempo.

El verdadero problema: rendimiento en inferencia

Más allá de la narrativa financiera, el punto crítico parece ser técnico.

Según diversas fuentes citadas por Reuters, OpenAI no estaría plenamente satisfecha con el rendimiento de algunos chips de Nvidia en tareas de inferencia.

¿Qué es la inferencia?

Es el proceso mediante el cual un modelo de IA ya entrenado genera respuestas. Es lo que ocurre cada vez que:

- ChatGPT responde una pregunta

- Codex genera código

- Un modelo de imagen produce una ilustración

La inferencia exige:

- Baja latencia

- Alta eficiencia energética

- Costes operativos optimizados

En herramientas como OpenAI Codex, se habrían detectado limitaciones de rendimiento asociadas a hardware basado en GPU tradicionales.

Y aquí empieza el verdadero movimiento estratégico.

OpenAI busca reducir su dependencia de Nvidia

Aunque Nvidia domina el mercado de GPUs para IA, OpenAI lleva meses diversificando su infraestructura.

Entre sus movimientos recientes destacan:

1. Acuerdo con Cerebras

En enero, OpenAI cerró un acuerdo de 10.000 millones de dólares con Cerebras para añadir 750 megavatios de capacidad dedicada a inferencia de baja latencia hasta 2028.

2. Alianza con AMD

En octubre se anunció un acuerdo por 6 gigavatios de GPUs AMD.

3. Chip propio con Broadcom

OpenAI también trabaja en el desarrollo de un chip personalizado junto a Broadcom para reducir su dependencia estructural de Nvidia.

4. Conversaciones con Groq

OpenAI exploró soluciones de inferencia con Groq, especializada en baja latencia. Sin embargo, Nvidia firmó un acuerdo de 20.000 millones con Groq y absorbió parte de su liderazgo.

La conclusión es clara: OpenAI no quiere depender exclusivamente de Nvidia.

¿Por qué esto preocupa al mercado?

Nvidia no solo vende chips. También invierte estratégicamente en empresas que luego compran su hardware. Algunos analistas, ya han criticado lo que llaman un “círculo virtuoso financiero”:

- Nvidia invierte en una empresa de IA

- Esa empresa compra GPUs Nvidia

- El crecimiento proyectado impulsa la acción de Nvidia

Si OpenAI reduce su dependencia, ese modelo pierde fuerza.

Luego de estos últimas declaraciones, las acciones de Nvidia registraron caídas moderadas, reflejando cierta inquietud dentro de los mercados inversores.

¿Hay tensiones reales entre Nvidia y OpenAI?

Públicamente, ambas compañías han intentado enfriar la narrativa a posteriori.

Sam Altman declaró: “Nos encanta trabajar con NVIDIA y fabrican los mejores chips de IA del mundo.”

Y por su parte, Jensen Huang aseguró que Nvidia hará “la mayor inversión de su historia” en OpenAI, aunque descartó que fuese de 100.000 millones.

Lo que realmente está en juego: el futuro del hardware de IA

Este episodio refleja algo mucho más grande:

1. La transición del entrenamiento a la inferencia

El entrenamiento masivo sigue siendo dominio claro de Nvidia; pero, la inferencia eficiente y escalable, es el nuevo campo de batalla.

2. La presión por reducir costes

Operar modelos como GPT a escala global requiere una infraestructura que optimice cada milisegundo y cada vatio.

3. La integración vertical

Las grandes empresas de IA quieren diseñar sus propios chips para:

- Reducir costes

- Aumentar control

- Evitar cuellos de botella

Google lo hizo con TPUs.

Amazon con Trainium.

OpenAI parece seguir ese camino.

¿Se ha desinflado el acuerdo o nunca existió?

La respuesta más honesta es, que este acuerdo jamás fue un compromiso cerrado. Con el anuncio se creo un gran impacto mediático, pero en la práctica:

- Solamente era una intención.

- Dependía de rondas de financiación.

- Estaba sujeta a condiciones técnicas y estratégicas.

Conclusión

Nvidia continúa siendo el líder indiscutible en hardware de IA. Aunque el mercado está evolucionando:

- La inferencia gana protagonismo.

- Surgen competidores especializados.

- Las grandes empresas desarrollan chips propios.

OpenAI no está rompiendo con Nvidia, pero está diversificando; y eso cambia el equilibrio de poder en la industria de la inteligencia artificial.

La era de la dependencia absoluta de un único proveedor podría estar llegando a su fin y habrá que esperar, para poder llegar a conocer que es realmente lo que esto significa dentro del mercado global de la tecnología.